近年の AI(Artificial Intelligence、人工知能)技術への関心の高まりと相まって、その利用による社会的リスクについても関心が高まり、そのガバナンスの必要性が指摘されています。

計 10 回にわたる本コラムでは、このような AI 技術による社会的リスクとそのガバナンスを巡る全体像について俯瞰していきます。

本連載の筆者は、市川類 東京科学大学 データサイエンス・AI全学教育機構 特任教授 / 一橋大学 イノベーション研究センター 特任教授 です。

©2024 Tagui Ichikawa(本コンテンツの著作権は、市川 類 様に帰属します)

第3回 社会的リスクに対応する制度としてのガバナンス

前回のコラムでは、新技術の利用による社会規範への抵触として「社会的リスク」が生じることをお話しました。

今回のコラムでは、この社会的リスクを低減・管理するための技術ガバナンスについてお話します。

(1) 社会全体の制度としての技術ガバナンス

第一回のコラムにおいて、技術ガバナンスとは、「技術によって生じるリスクを、ステークホルダーにとって受容可能な水準で管理しつつ、 それらからもたらされる正のインパクトを最大化することを目的とする、 技術的、組織的、社会的システムの設計、運用」と定義されることを説明しました。

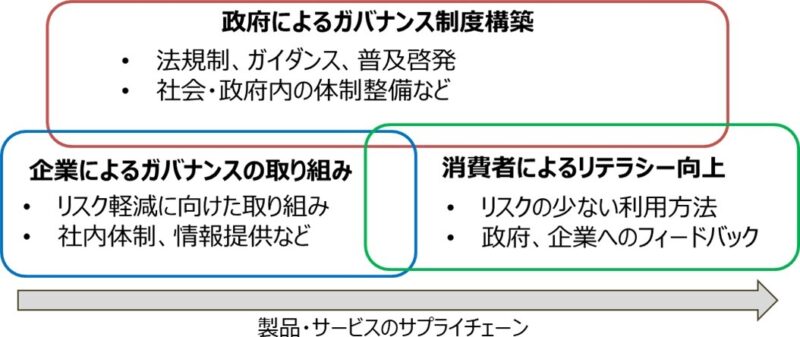

すなわち、技術ガバナンスとは、「技術的、組織的、社会的システムの設計、運用」ですので、その実現のためには、社会的システムとして、各主体が相互に連携しながら技術面も含めて、制度化・組織化に取り組むことが求められることになります。その際、もちろん必要に応じて、政府が、技術の利用を制限・規制するような法制・ルールを整備することも重要となる場合もありますが、技術ガバナンスにおいては、それだけでなく、政府、企業、消費者などとの連携による社会システムを構築していくことが重要になります(図7参照)。例えば、ナイフの場合でも、従来からある傷害罪などのルールに加え、政府による銃刀法などによる規制、企業(供給者)によるケガをしにくいようなナイフの開発、消費者におけるナイフの利用にあたってのリテラシーの向上などが組み合わさって、社会としてのリスク低減に向けた取り組みが行われています。

このような中で、企業においても、政府におけるガバナンス政策・規制動向を踏まえ、ユーザー・消費者に対して適切な情報を提供しつつ、社内におけるガバナンス体制整備に取 り組むことが必要になります。

図7:社会全体としての技術ガバナンス制度(リテラシー向上を含む)

(2) 技術と制度(ガバナンス)の共進化

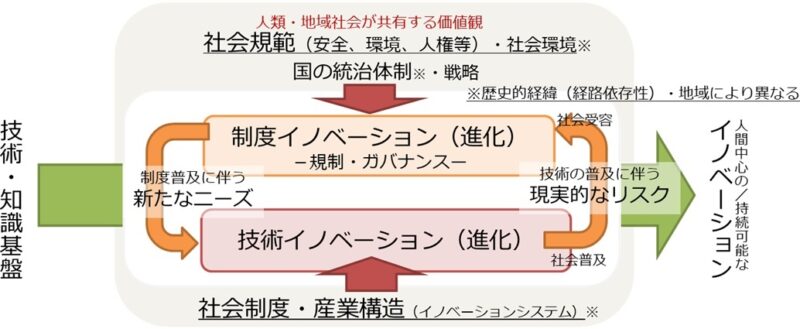

技術に係る社会のガバナンスシステムの中核となる政府によるガバナンス制度に関しては、長期的に見た場合には、技術のイノベーション(進化)ととともに、進化していくものと理解できます。

具体的には、新たな技術が登場し、その社会への普及が進展すると、そのイノベーションに係る経済進化の過程で、その技術の利用形態に関して一定のパターン(ルーティン)が形成されます。その上で、その技術の利用に係るルーティンが、社会規範に抵触するような場合には、社会的リスクとして社会問題となって顕在化します。その際、現代社会では、当該国で共有される社会規範やイノベーションへの影響などを踏まえつつ、当該国における国家統治体制のもとで、法令その他のルールなどの技術ガバナンス制度が整備されることになります。また、このように新たに整備された技術ガバナンス制度は、その後のイノベーションに大きな影響を与えることとなり、その結果、社会規範に沿った形で、技術と制度の共進化が進むことになります(図8参照)。

例えば、自動車の事例を考えてみましょう。自動車の発明・開発は、社会に大きな便益をもたらしましたが、その後の普及によるルーティン化に伴い、交通事故などの安全問題や排ガスなどの環境問題などの社会規範への抵触が生じ、社会問題化しました。これに対応し、交通法規や車両安全などの法令が整備され、その結果、より安全で、環境に配慮した自動車が普及するようになりました。

なお、一般的に、法制度においては規制対象の明確化が前提になることから、そのルーテ ィンが固まっていない時点においては、倫理原則やガイドラインなどによるルール整備になることも少なくありません。このため、企業においては、政府による規制制度の整備を待つまでもなく、技術の進展に応じて迅速かつ、政府に先んじて取り組むことが課題になります。

図8:技術と制度(ガバナンス)の共進化

(3) AI 技術の登場と新たなガバナンスに係る対応の必要性

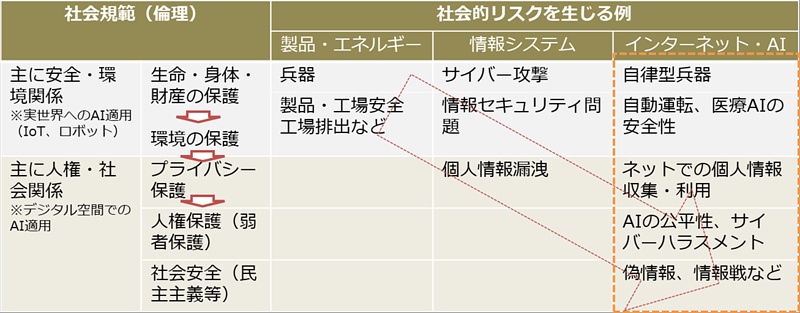

また、自動車の場合も含めて、これまでの既存の汎用技術の多くは、製造・エネルギーに係る技術であり、このため、主に安全や環境に係る社会的リスクの概念化がなされ、必要な法制度が整備されてきたのは、前述のとおりです。このため、これらの社会的リスクに

対応するガバナンスとしては、長年の蓄積を踏まえ、専門家が基準を策定することによって消費者の信頼を得るという仕組みの下、相対的に技術問題に落とし込んで対応することが可能になっていました。

これに対し、近年急速に伸びつつあるデジタル・AI 技術では、むしろ人権・社会などに係る社会的リスクが課題になるとともに、従来の安全問題などに係る社会的リスクも複雑化してきています(図9参照)。このような社会的リスクに関しては、倫理問題とも言われるとおり、社会としてまだ十分に議論されておらず、社会としての受容基準も明確にされていないのが現状であることは、前述したとおりです。それに加え、その性質上、そのリスクを評価するためには、多様な利害関係者(マルチステークホルダー)の意見を聞くことが前提となります。このような中、デジタル・AI 時代においては、技術ガバナンスの在り方自体も大きく変わりつつあることに留意することが必要でしょう。

図9:社会的リスクの範囲の拡大

それでは、AI 技術の利用により、具体的にどのような社会的リスクが生じ得るのでしょうか。次回以降は、これについて説明していきたいと思います。

これまでのコラム

(第1回)イノベーションのためのガバナンス

(第2回)社会規範・倫理と技術による社会的リスク

筆者紹介 市川 類(いちかわ たぐい)

東京科学大学 データサイエンス・AI全学教育機構 特任教授

一橋大学 イノベーション研究センター 特任教授

筆者紹介の詳細は、第1回をご参照ください。