2024年3月

一般財団法人 機械システム振興協会

目次

第1章 フォーラムの趣旨

1-1. 趣旨

1-2. フォーラム委員

第2章 生成AIとプロンプトエンジニアリングの基礎(第1回フォーラムでの講演内容)

2-1. はじめに

2-2. 個別事項の説明

第3章 生成AIにおける外部データ活用(第2回フォーラムでの講演内容)

3-1. はじめに

3-2. 個別事項の説明

第4章 生成AIと著作権(第3回フォーラムでの講演内容)

4-1. はじめに

4-2. 生成AIと第三者データ利用に関する論点一覧

4-2-1. 対象データの種類

4-2-2. 対象データの利用場面

4-3. 生成AIと著作権侵害

4-3-1. AI開発・学習と著作権侵害(パターン1)

4-3-2. AI生成物の生成・利用と著作権侵害(パターン2)

4-3-3. AI生成物の生成・利用と著作権侵害(パターン3)

4-3-4. AI生成物の生成・利用と著作権侵害(パターン4)

第5章 機械システム設計・開発における生成AIの活用と課題

5-1. はじめに

5-2. 機械システムの設計開発における生成AIの活用場面

5-3. 活用上の課題・留意点

第6章 機械システム設計・開発における生成AIの使用に関する効果・影響とリスクの評価方法

6-1. はじめに

6-2. 機械システム設計・開発における生成AI の評価方針

6-3. 生成AIの使用に関する効果・影響とリスクの評価フレーム

6-4. 活用におけるメリットとデメリットのマッピングの方法論について

第7章 まとめ

7-1. はじめに

7-2. 機械システムの設計、開発における活用可能性について

7-3. 機械システム設計・開発における生成AIの使用に関する効果・影響とリスクの評価について

(Appendix)本フォーラムで行った講演サマリー 【機械システム振興協会掲載サイトのURL】

第1回講演サマリー「生成AI時代のプロンプトエンジニアリング入門」(2023年8月3日実施)

講師: 今井 翔太 氏 東京大学大学院 工学系研究科 技術経営戦略学専攻

https://www.mssf.or.jp/info115/

第2回講演サマリー「LLM における外部データ活用入門」(2023年9月29日実施)

講師: 江上 周作 産業技術総合研究所 人工知能研究センター 主任研究員

https://www.mssf.or.jp/info130/

第3回講演サマリー「生成AIと著作権について」(2023年10月26日実施)

講師: 柿沼 太一 STORIA法律事務所 弁護士

https://www.mssf.or.jp/info132/

第1章 フォーラムの趣旨

1-1. 趣旨

生成AI は、自己学習によってデータを解析し、新しい情報を生成することができます。そのため、機械システムの設計や開発において、AI がデザインやシミュレーションを担当することで、機械システムの内容の向上や、人的ミス・労力の削減が期待できます。

また、現場導入後の運用においても、AI が自己学習を継続することで、常に最適な状態を維持できる可能性があります。このような運用方法によって、システムの効率化や生産性の向上、品質の向上などが期待されます。そのため、生成AI の機械システム設計開発への活用可能性を検証することは、産業界や社会において、大きな意義があると考えられます。

生成AI に関しては、政府においても、2023年5 月11 日、第1回の「AI 戦略会議」が開催され、人工知能(AI)の利用に向けた方策に関して、関係省庁によるAI戦略チームでの議論がスタートし、同年12月第7回開催では、今後の課題として、AIのガバナンス、規制のあり方、高度AIシステムの競争力確保、AIの利用促進に関する課題が示されました。また、2024年2月14日には、独立行政法人情報処理推進機構(IPA)に「AIセーフティ・インスティテュート」が設置され、AIの安全性評価に係る調査、基準、実施方法等の検討が進められています。

本フォーラムでは、機械システム、生成AI、ユーザ企業の有識者から構成する委員会(フォーラム)を設置し、主に以下の2つの観点から生成AI の機械システムの設計、開発、運用における活用可能性を議論しました。

【1】 ChatGPT 等の生成AI について機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける使用結果に基づく活用可能性、効果の検討と課題抽出。

【2】 機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける生成AI の使用に関するリスクマネジメントの考え方、R-map 等による系統的なリスク評価のあり方の検討。

1-2. フォーラム委員

| 氏名 | 所属 | 役職 |

| 【委員長】 | ||

| 村上 存 | 東京大学 大学院工学系研究科 機械工学専攻 | 教授 |

| 【アドバイザ】 | ||

| 松尾 豊 | 東京大学 大学院工学系研究科 技術経営戦略学専攻 | 専攻長、教授 |

| 【委員】 | ||

| 野口 和彦 | 横浜国立大学 リスク共生社会創造センター | 客員教授 |

| 前川 徹 | 東京通信大学 情報マネジメント学部 | 教授 |

| 江上 周作 | 産業技術総合研究所 人工知能研究センター データ知識融合研究チーム | 主任研究員 |

| 神野 すみれ | 旭化成(株)生産技術本部 生産技術センター 産機システム技術部 | 主幹技師 |

| 九十九 弘 | 旭化成(株)ライフイノベーション事業本部 デジタルイノベーション推進部 スマートファクトリー推進室 | 室長 |

| 福永 究 | (株)クボタ 研究開発本部 研究開発統括部 | 部長 |

| 平岡 洋二 | (株)クレオ R&D本部 新機種チーム 兼 技術本部 | 技師長 |

| 伊藤 寿勝 | (株)PFU 次世代事業開発室 | 技術開発部長 |

| 谷 立 | (株)リコー RDP 経営戦略本部経営統括センター DX推進室 ソシューション開発グループ | グループリーダー |

| 相澤 徹 | 一般財団法人 機械システム振興協会 | 専務理事 |

| 【専門委員】 | ||

| 浅井 一樹 | 東京大学 村上研究室 | 修士課程 |

【事務局】 一般財団法人 機械システム振興協会: 理事 杉浦秀明、 成田香里

【第1回 開催状況】

第2章 生成AIとプロンプトエンジニアリングの基礎

(第1回フォーラムでの講演内容)

【記載内容に関する注意事項】 本章は、第1回の本フォーラムにおける「生成AI時代のプロンプトエンジニアリング入門」(講師:今井 翔太 氏 東京大学大学院 工学系研究科 技術経営戦略学専攻)の講演内容に基づき記載しています。したがって、講演が行われた2023年8月3日時点での状況に基づく記載内容です。この分野では技術の進展が著しいため、以下の記載の一部に最新の状況とは異なる内容が含まれることがあり得ますので、ご注意ください。

2-1. はじめに

人工知能(AI)は、近年の技術進歩により多くの分野で活用されています。その中でも、特に注目されているのが「生成AI」です。生成AIとは、大量のデータを学習し、ユーザの指示に対して情報やアイデアを自動的に作り出すAIの一種です。この生成AIでは、文章や音楽、画像、設計図など、さまざまな形式の内容を作り出すことが可能です。

生成AIの活用は、多岐にわたる分野で可能性を開くと期待されています。しかし、生成AIが出力する内容をより具体的で有用なものにするためには、適切な指示を与えることが重要となります。ここで重要となるのが「プロンプトエンジニアリング」です。プロンプトエンジニアリングとは、生成AIに対する指示を最適化し、より具体的で有用な結果を引き出す技術です。

本章では、生成AIとプロンプトエンジニアリングの基本的な概念と、それぞれの特徴、活用方法、そして注意点について解説します。

[生成AIとプロンプトエンジニアリングの連携]

生成AIとプロンプトエンジニアリングを組み合わせることで、AIの生成能力をより具体的かつ効果的に活用することが可能です。例えば、明確な指示を与えることでAIに特定の文体で記事を書かせたり、特定のスタイルのデザインを作成させることなどが可能となります。

[生成AIとプロンプトエンジニアリングの限界と対策]

生成AIとプロンプトエンジニアリングには、AIがまだ学習していない抽象的な指示や、高度な創造性を必要とするタスクなど、一部対応が難しい課題が存在します。これらの限界を理解し、人間とAIの協働や、AIの学習データの適切な管理などを通じて、限界を克服する努力が求められます。

[プロンプトエンジニアリングとAIの学習データ]

プロンプトエンジニアリングはAIの学習データと密接に関連しています。より具体的な指示をAIに与えるためには、AIが学習するデータを適切に管理し、そのデータに基づいて指示を設計することが必要です。

[生成AIの安全性と倫理]

生成AIを活用する際には、その安全性と倫理について考慮する必要があります。AIが生成する内容が法律や倫理に適合しているか、またその内容がユーザの安全を脅かす可能性がないかなど、注意深く評価することが求められます。

2-2. 個別事項の説明

[1]生成AI(Generative AI)

生成AIは、言語生成AI(ChatGPT、PaLMなどの大規模言語モデル)や画像生成AI(Stable diffusionやMidjourneyなどの拡散モデル)のように、「人間が行うような新たなアイデアやコンテンツを作り出す能力を持つ人工知能の一種 」である。(【図1】)

【図1】第1回フォーラム講師 今井 翔太 氏による提供

[2]言語モデル(Language Model)

– 単語や文章が生成される確率をモデル化したもの

– 例えば、以下のような文の穴埋め問題で、「このりんごはとても」までを入力して、次の( )に入る単語の確率を出力し、最も高い確率の単語を割り当てる

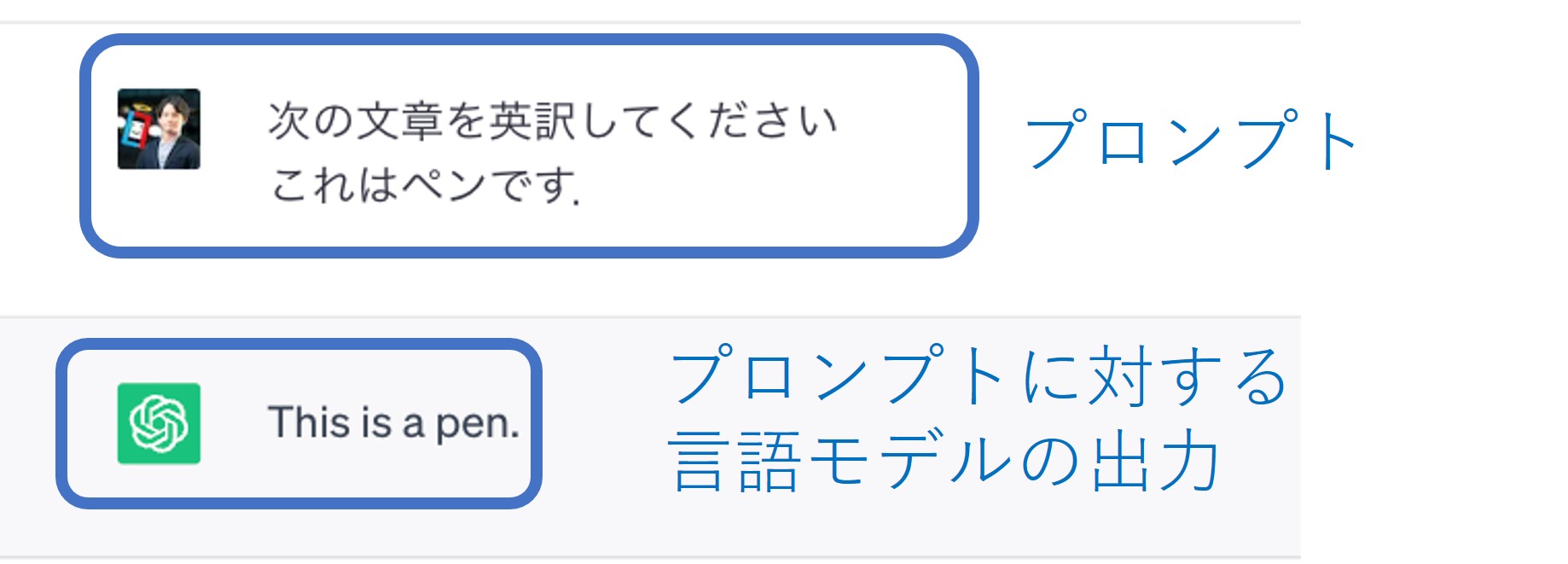

[3]プロンプト(Prompt)

– 言語モデルの出力を得る(促す, Prompt)ために、言語モデルに入力する文字列、指示文を指す(【図2】)

【図2】第1回フォーラム講師 今井 翔太 氏による提供

– 言語モデルの知識から所望の出力(プログラムコード、提案、翻訳文、質問回答)を得るには、適切なプロンプトを入力する必要がある

– プロンプトを工夫してAIに所望の出力をさせる技法の試みはプロンプトエンジニアリングとも呼ばれる

[4]使用上の留意点

①個人情報,機密情報の入力

– OpenAIはユーザの入力をChatGPTの学習に使う

– 個人・機密情報を入力すると,それが学習に使用され、将来的に他の人がChatGPTを使用した時に漏洩する可能性

②ハルシネーション

– 現在のChatGPTなどの大規模言語モデルは、ある知識・事実に関して誤った出力をしてしまうハルシネーションが問題となっている

– 現在の研究段階ではこれを完全に回避する手段はなく、ChatGPTの出力情報を使用する場合は注意が必要

③トークン制限

– 大規模言語モデルは、ベース技術のTransformerの仕様上、入力できる文字数(トークン数)に制限がある

– 現時点では、大量の社内文書、コードベースをまとめて処理することは困難

④モデルの性能変化

– OpenAIはChatGPTのモデルを更新しているが、最新版で一部の性能が悪化していることが報告されており、必ずしも最新のモデルを使うのが良いとは限らない (注)ただし、2023年8月時点でのGPT-4に関する記載であることに注意。

第3章 生成AIにおける外部データ活用

(第2回フォーラムでの講演内容)

【記載内容に関する注意事項】 本章は、第2回の本フォーラムにおける「LLM における外部データ活用入門」(講師:江上 周作 産業技術総合研究所 人工知能研究センター 主任研究員)の講演内容に基づき記載しています。したがって、講演が行われた2023年9月29日時点での状況に基づく記載内容です。この分野では技術の進展が著しいため、以下の記載の一部に最新の状況とは異なる内容が含まれることがあり得ますので、ご注意ください。

3-1. はじめに

生成AIは、大量のデータを学習し、それに基づいてユーザの指示に対して情報やアイデアを作り出す能力を持っています。この学習データは、AIの生成能力を大きく左右します。つまり、適切な学習データを提供することにより、AIはより具体的で有用な結果を生成することが可能となります。

そのため、生成AIの活用においては、どのようなデータをAIに学習させるかが重要な問題となります。このデータは、AIが事前に学習する内部データだけでなく、AIが参照や追加学習のために利用する外部データも含みます。

外部データとは、ユーザの質問に対する回答を提供したり、特定の課題に対する解決策を提案したりするためにAIが参照する情報源のことを指します。これはインターネット上の記事やデータベース、専門的な知識をまとめた文書など、さまざまな形式を取ります。

本章では、生成AIがどのように外部データを活用するのか、その活用によってどのような効果が期待できるのか、またその際の注意点は何かについて解説します。

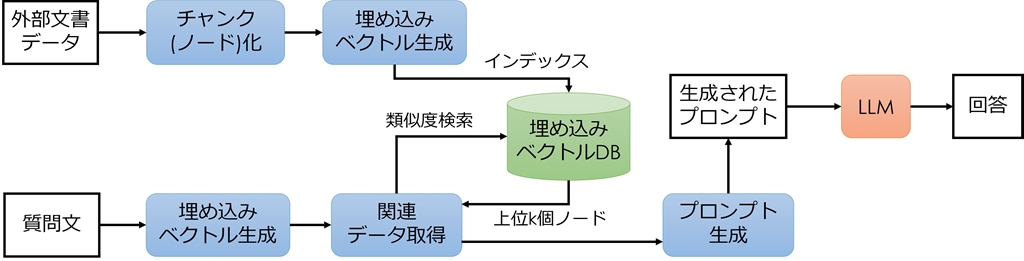

[Retrieval-Augmented Generation (RAG)]

Retrieval-Augmented Generation (RAG)は、生成AIが外部データを効率的に取り込む手法として注目されています。RAGは、指定されたタスクに最適な情報を外部データから取得し、その情報を基にAIが出力を生成するという流れを実現します。

[生成AIアプリケーション開発]

学習データに含まれていない外部データをAIに与えることで、具体的な回答を得るフレームワークとして、LangChainやLlamaIndex等があります。これらのフレームワークを活用することで、生成AIを利用したRAGや、生成AIと外部ツールを組み合わせたシステムの実装が可能です。。

[Large Language Models (LLM)とハルシネーション問題]

Large Language Models (LLM)とは、大量のテキストデータから言語のパターンを学習し、人間のようなテキストを生成するAIの一種です。しかし、LLMは実在しない情報や誤った情報を生成する「Hallucination(幻覚)」問題が存在します。

[知識グラフ質問応答(Knowledge Graph Question Answering)とハルシネーション問題]

Hallucination問題に対する解決策として、知識グラフ質問応答(Knowledge Graph Question Answering)が注目されています。知識グラフは、明示化されたファクトデータや論理的知識のグラフデータであり、KGQAはAIを知識グラフに接続し、AIが実在する情報に基づいて回答を生成することを可能にします。この方法論については、現在も研究が進められています。

[外部データ活用の今後の展望]

外部データを活用した生成AIの技術は、今後もさらに進化を遂げ、より精緻な出力生成や問題解決能力が期待されます。

3-2. 個別事項の説明

[1] ChatGPTの使い方(ChatGPT Plugins)

①概要

– 第三者が開発したアプリケーションで動作する

– プラグインが実行されるとプロンプトはプラグイン側に送信される

②使用方法

– チャット開始時に使用するプラグインを選択する(複数選択可)

– プラグインを実行するかどうかをプロンプトごとにChatGPTが自動的に判断する

[2] ChatGPT Advanced Data Analysis

– 旧Code Interpreter

– ファイルのアップロードとダウンロード、コードの実行が可能

[3] 外部データの活用

①外部データを取り込んでLLMを利用する手法として、Retrieval-Augmented Generation (RAG)が注目されている。外部データとしてテキストを与えた場合には、RAGにより外部データに関連した具体的な回答が得られる。(【図3】)

– LangChain, LlamaIndexなどのフレームワークが有名

【図3】一般的なRAGの概略図

②RAGの用語解説

– Chunk(チャンク):一定のトークン数で分割されたテキストの塊

– Node(ノード):チャンクに対応するデータベース内のオブジェクト

– 埋め込みベクトル生成:テキストの意味を表現する数百~数千次元のベクトル値を生成する

–プロンプト生成:検索により取得したノードのテキストとユーザが与えた質問文を元にプロンプトを生成する

[4] 知識の活用

– LLMの課題の一つ:ハルシネーション(幻覚)

– LLMに、明示化されたファクトデータや論理的知識を接続することで解決できないか⇒ 知識グラフ

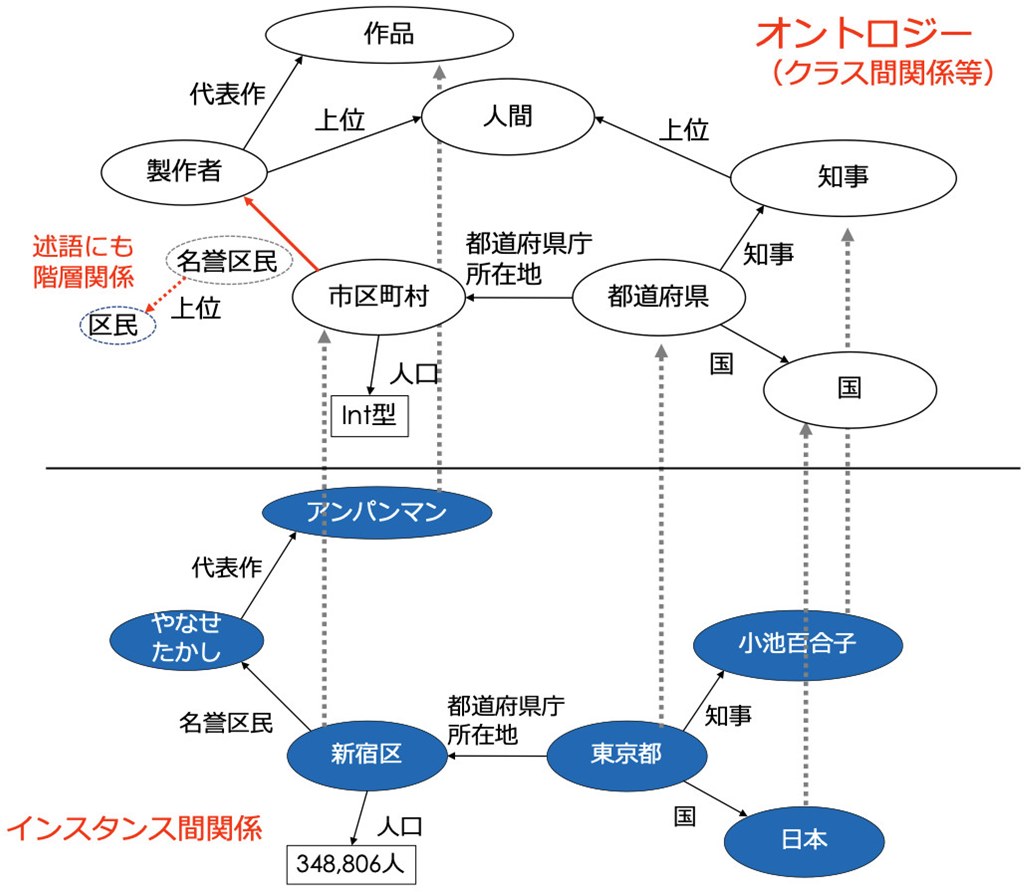

①知識グラフ(ナレッジグラフ:KG)

– 主語,述語,目的語の三つ組みにより様々な知識をグラフ構造で表現する(【図4】)

【図4】 知識グラフ (第2回フォーラム講師 江上 周作氏による提供)

②Knowledge Graph Question Answering

KGQA:KGに対して自然言語による質問応答を行う技術であり,LLMのHallucinationの解決策の一つとしても期待されている

第4章 生成AIと著作権(第3回フォーラムでの講演内容)

【記載内容に関する注意事項】 本章は、第3回の本フォーラムにおける「生成AIと著作権について」(講師:柿沼 太一 STORIA法律事務所 弁護士)の講演内容に基づき記載しています。したがって、講演が行われた2023年10月26日時点での状況に基づく記載内容です。この分野では技術の進展が著しいため、以下の記載の一部に最新の状況とは異なる内容が含まれることがあり得ますので、ご注意ください。

4-1. はじめに

生成AIは、自動的に文章や画像、音楽などを生成する能力を持つ一方で、その生成物が既存の著作物と類似している場合、著作権侵害の問題が生じる可能性があります。これは、生成AIが学習するデータが既存の著作物であった場合や、生成AIが既存の著作物を参考に作品を生成した場合に特に重要となります。

著作権は、創作物の作者がその作品の利用について決定する権利を保護するための法制度ですが、生成AIが既存の著作物を無断で利用し、その結果として作品を生成した場合、それは原則として著作権侵害となります。

しかし、生成AIの学習データとして既存の著作物が使用された場合や、生成AIが既存の著作物に基づいて作品を生成した場合の著作権侵害の問題は、簡単ではありません。これは、生成AIがどの程度既存の著作物を参考にしたのか、またその結果生成された作品が既存の著作物とどの程度類似しているのかなど、具体的な事情によって異なるからです。

本章では、具体的な事例をもとに、生成AIと著作権侵害の関係について詳しく解説します。特に、生成AIが第三者の画像を用いて画像を生成した場合や、生成AIが既存の著作物を元に作品を生成した場合など、具体的なケースについて考察します。

4-2. 生成AIと第三者データ利用に関する論点一覧

対象データの種類 × 対象データの利用場面

4-2-1. 対象データの種類

[1] 他人が知的財産権を保有しているデータ

– 具体例:著作物

– 制限の内容:原則として著作権者の承諾がなければ当該著作物を複製・公衆送信等できない

[2] 契約上、利用について制限がかかっているデータ

– 具体例:NDAを締結して受領した秘密情報

– 制限の内容:NDAにおける秘密情報の目的外利用の禁止や第三者提供の禁止

[3] 取得や利用について法規制がかかっているデータ

– 具体例:個人情報・個人データ

– 制限の内容:個人情報(個人データ)の取得・利用・提供に関する個人情報保護法上の規制

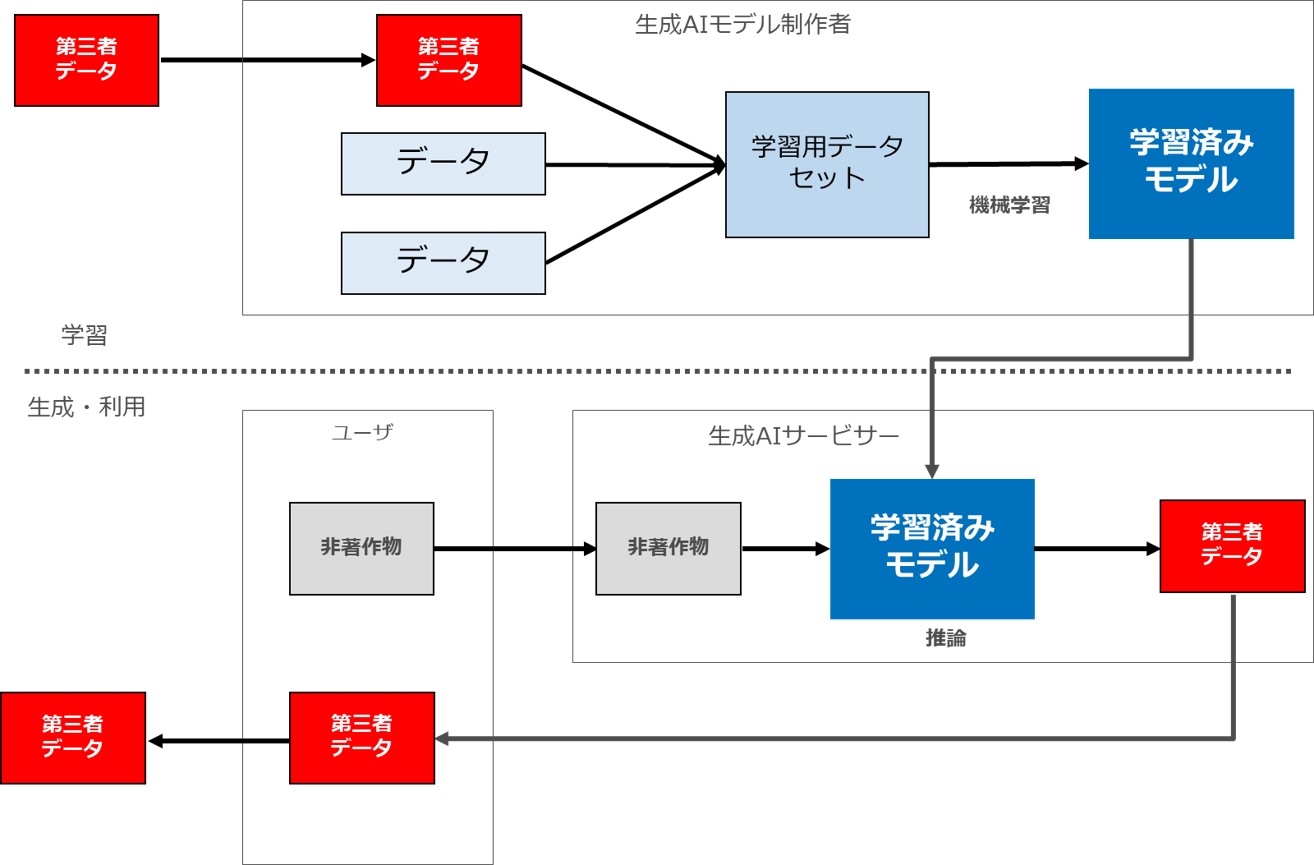

4-2-2. 対象データの利用場面

[1] 生成AIの学習

[2] 生成AIへの入力

[3] 生成AIを利用した生成物の生成と利用に分けて考えるとよい

4-3. 生成AIと著作権侵害

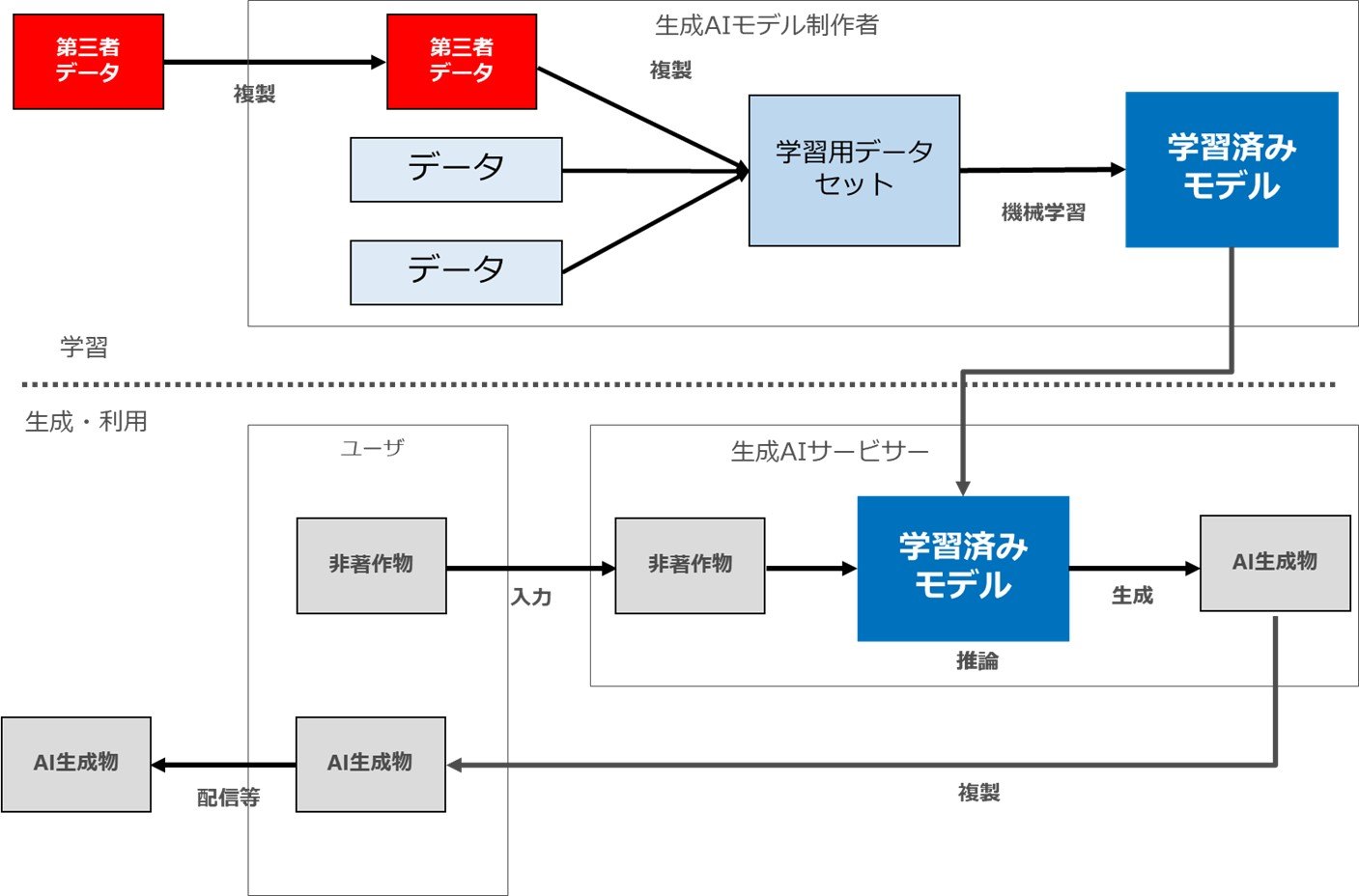

4-3-1. AI開発・学習と著作権侵害(パターン1)

【図5】第3回フォーラム講師 柿沼 太一氏による提供

[1] 具体例

(1) 第三者が提供する画像生成AIのOSSを使い、他者の画像でファインチューニング(FT; LoRA(Low-Rank Adaptation)を含む)を行って自社専用の画像生成AIを構築

(2) 第三者が提供するLLM(Large Language Models)のAPI を利用した自社専用FAQシステムの構築の際、回答精度を上げるため、各種データによる当該LLMのFTを行う。

[2] 原則

– いずれの具体例も30条の4第2号により原則として適法

4-3-2. AI生成物の生成・利用と著作権侵害(パターン2)

[1] どのようなパターンか

生成AIに既存著作物を入力しているだけであり、生成AIによる処理結果として類似著作物が生成されていないパターン

【図6】第3回フォーラム講師 柿沼 太一氏による提供

[2] 権利制限規定の適用

– 原則

生成AI内において、入力された既存著作物を解析しAI生成物を生成する行為(正確には「AI生成物の

生成を行うための、入力著作物のモデル内での解析行為」)

→「情報解析(30条の4第2号)」に該当

①当該「情報解析」のために既存著作物を入力する行為

②入力のためにDB内に既存著作物を蓄積する行為

③既存著作物を電子化する行為はすべて「情報解析のために必要な行為」に該当し、30条の4第2号により原則として適法

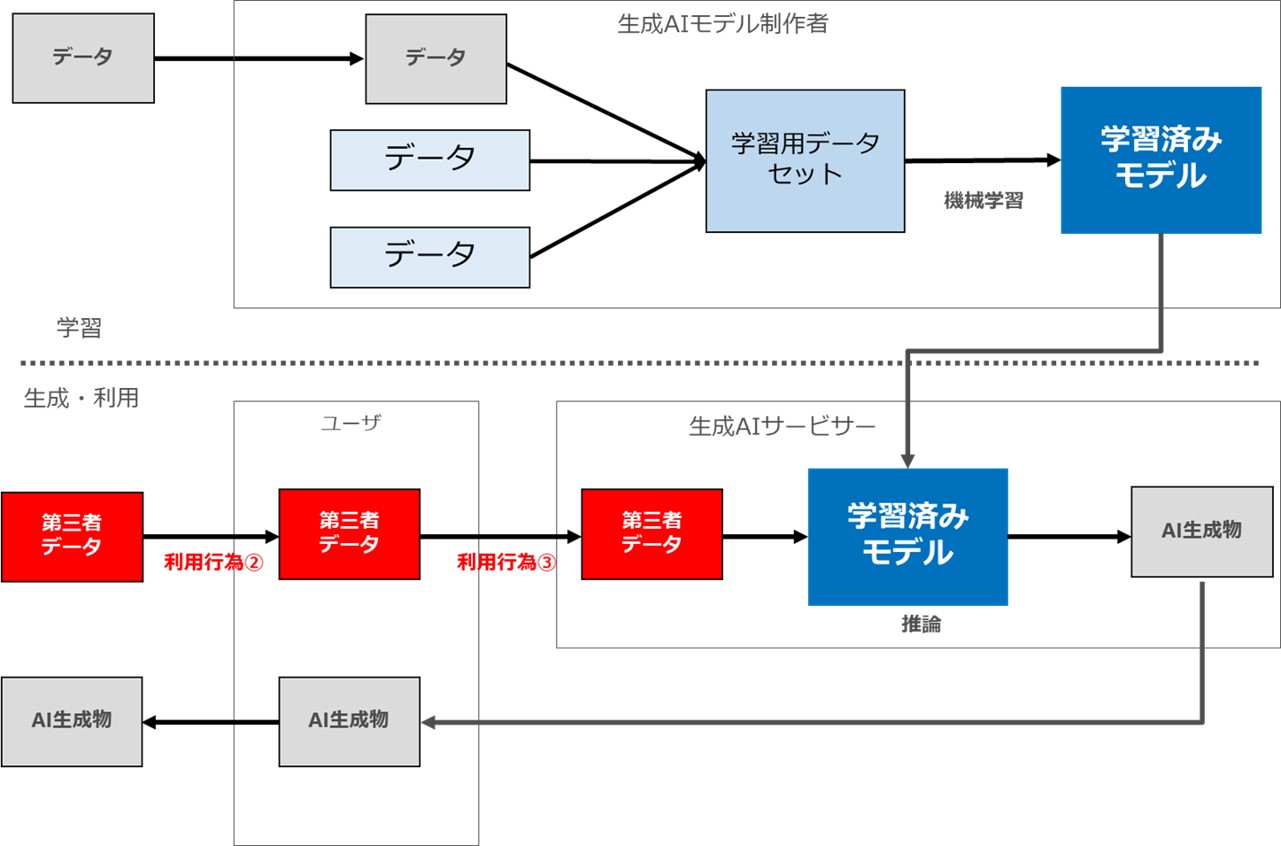

4-3-3. AI生成物の生成・利用と著作権侵害(パターン3)

[1] どのようなパターンか

生成AIに既存著作物を入力し、生成AIによる処理結果として入力データと類似するAI生成物が生成され、当該AI生成物を配信・譲渡等するパターン

【図7】第3回フォーラム講師 柿沼 太一氏による提供

[2] 各行為の分析

①入力行為

パターン1と同様、「情報解析」のために必要な行為に該当。しかし、このパターンは入力のみ行っているパターン2と異なり、AI生成物を実際に生成し、かつ配信等していることから入力行為について享受目的ありとして30条の4の適用なくNGと思われる。

②AI生成物の生成行為

私的利用目的複製(30条)・検討過程における利用(30条の3)が適用されれば適法。なお、AI生成物の生成行為は「情報解析の結果」なので30条の4の適用はない。

③AI生成物の複製行為

各種権利制限の適用がなく著作権侵害に該当する。

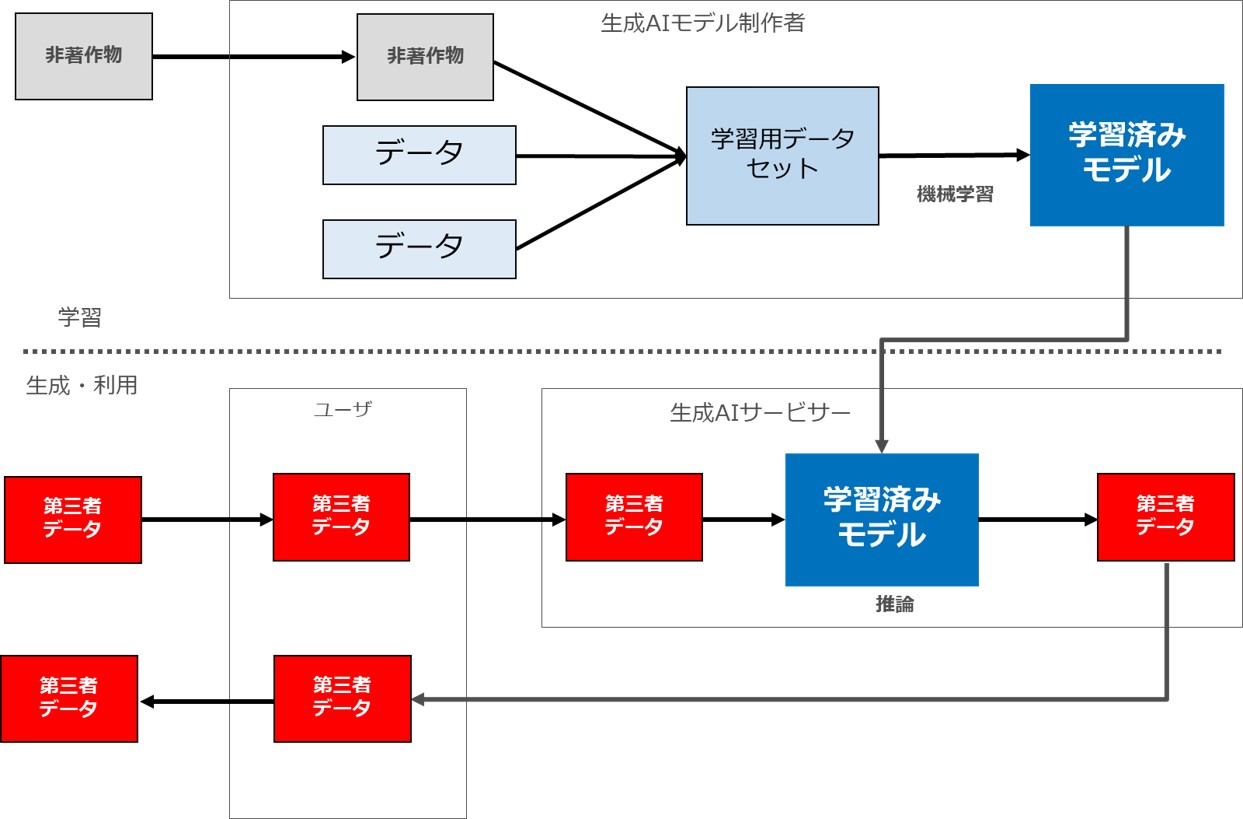

4-3-4. AI生成物の生成・利用と著作権侵害(パターン4)

[1] どのようなパターンか

学習に既存著作物が使われており、生成AIに生成指示や非著作物を入力したところ、生成AIによる処理結果として既存著作物の類似著作物が生成され、当該類似著作物を利用(公衆送信・譲渡等)しているパターン

【図8】第3回フォーラム講師 柿沼 太一氏による提供

[2] ユーザが既存著作物の存在を知っていたり、学習に既存著作物が利用されていることを知っている場合(ユーザ自身が既存著作物を用いてFTした場合等)

– 依拠性:肯定

– 権利制限規定:適用なし

– 故意・過失:あり

[3] ユーザが既存著作物の存在を知らない場合

– 依拠性:難問

– 権利制限規定:適用なし

– 故意・過失:なし

第5章 機械システム設計・開発における生成AIの活用と課題

5-1. はじめに

生成AIは文章作成から設計図の作成、新商品開発のアイデア出しまで、あらゆる分野で応用が可能です。生成AIは膨大な量のデータから新たなパターンを見つけ出す能力を有しており、これによって従来人間が行っていた設計や開発の作業を効率化し、新たな発見を促進することが期待されています。

しかし、生成AIの活用には課題も存在します。その学習データの選択やAIの出力結果の評価など、AIを効果的に活用するためには適切な知識と理解が必要です。

本章では、機械システム設計・開発における生成AIの活用の可能性と、その活用上の課題について解説します。

[活用の可能性]

生成AIは機械システム設計や開発の領域で大きな可能性を秘めています。AIは既存のデータから新たなパターンを見つけ出すことができるため、新しい設計のアイデアを提供したり、最適な開発プロセスを提案したりすることができます。また、AIは人間が見落としがちな小さな変化やパターンも検出することができるため、より洗練されたシステム設計や開発を可能にします。

[活用上の課題・留意点]

生成AIを機械システム設計や開発に活用する際には、いくつかの課題と留意点があります。まず、AIが生成する結果は学習データに大きく依存します。そのため、適切な学習データを準備し、そのデータがバイアスを持たないことを確認することが重要です。また、AIはあくまでツールであり、最終的な決定は人間が行うべきです。AIの提案を鵜呑みにせず、その結果を適切に評価し、必要に応じて調整を行うことも必要となります。

[知識とスキルの必要性]

企業における設計開発の業務で生成AIを活用するためには、AIの動作原理や限界を理解した上で、設計開発の熟練者による生成結果の検証等を必ず行うなど、それを適切に操作・管理できる知識とスキルが必要です。これは、AIが意図しない結果を出力した場合や、AIのエラーに対処するために重要となります。

5-2. 機械システムの設計開発における生成AIの活用場面

本フォーラムでは、ChatGPT 等の生成AI について機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける使用結果に基づく活用可能性を議論した結果、以下の活用場面が挙げられました。

【製品企画】

・企画検討前の機能定義の事前整理、競合他社の開発に関する分析に役立つ

【製品システム設計、配置設計】

・生成AIにFMEA(failure mode and effects analysis、故障モード・影響解析)案を作成させ効率化が可能

【ハード機械設計】

・部品設計の制約整理(規格、社内規定、部品点数、強度、耐久性)による効率化が可能

【ソフトウェア設計】

・プログラムコーディング、FMEAへの活用を期待

【設計検証】

・検証計画、検証結果まとめの整理に使用可能

【妥当性検証】

・検証計画、検証結果まとめの整理に使用可能

【製品の品質改善】

・FTA(fault tree analysis、故障の木解析)、KT(Kepner-Tregoe)法の問題分析(PA、problem analysis)に応用できるか研究が必要

【機械リスクアセスメント】

・人間が見落とすリスク、抜けている危険事象も抽出可能

・簡易検証では何らかの助けにはなる

・ある程度人が挙げた危険事象の誤り(原因と結果がつながらない等)を検出、判定してくれそう

【設計全般】

・過去の不具合、市場問題など類似設計時の懸念点の事前把握、情報共有

・設計ガイド、安全規格等の検索、設計時の抜け漏れ、属人性の削減

【開発全般】

・デザイン(画像生成)、機械の稼働条件等のシミュレーションによる事前品質評価

・プログラムの整形、コメント付加、プログラミング言語間翻訳

【現場導入後】

・生産ラインや設備の変化を捉え、故障、トラブル、品質変化の予測

・設備、機械の予知保全等への活用

5-3. 活用上の課題・留意点

本フォーラムでは、ChatGPT 等の生成AI について機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける活用場面における課題について議論した結果、以下のような点が挙げられました。

【生成AIの利用方法・アウトプットの課題】

・人間が正誤判断を下せないAIの生成をプロセスで利用することの難しさ。

・該当プロセスの専門知識が乏しい作業者でも生成AIを用いて業務を行えるか不明確。

・人の思い付きレベルでの項目しか得られず、階層構造の指示への応答も苦手。

・各種外部データ利用手法(ファインチューニング、RAG、プラグイン利用)をどのように使い分けるか具体化されていない。

【外部知識の活用】

・サードパーティ製のプラグインの信頼性をどのように評価するか具体化されていない。

・プラグインの使用時には、ChatGPTの信頼性だけでなく、プラグインの信頼性の確認が必要。

・ソースコードや提供組織が公開されているので、利用の際は確認が必要。

・知識グラフに対して直接クエリ言語で問い合わせるKGQA(knowledge graph question answering)という手法がハルシネーションの解決策として期待されている。この他、知識グラフを大規模言語モデルに注入する技術も注目されている。

・外部データ連携に関しては既に様々な活用が進んでおり、出遅れればその企業の損失にもなり得る。

【全般的な課題】

・各社が最大限生成AIを活用すると類似性のある回答を利用することになる可能性があり、単に効率化の追求だけでは画一化に陥ってしまう。

・技術やスキルがない方でも、意匠登録や特許を入力データとして類似性を保ちつつ特許を簡単に回避するものが作れてしまうと困ったことになる。

・効率性を求められる場面で使い始め、社内で活用できる人材を増やしたり、使う時のルールをブラッシュアップしていくことが重要。

・新規開発のような業務では人間に頼る部分が大きいため、生成AIを利用した場合、企業の産物が画一化してしまうのではないか。

第6章 機械システム設計・開発における生成AIの使用に関する効果・影響とリスクの評価方法

6-1. はじめに

本章では、機械システム設計・開発における生成AIの活用に関する効果・影響とリスクの評価方法について解説します。この評価フレームは、現時点の生成AIの技術レベルを前提に、本フォーラムで考案した考え方として説明するものですが、技術の進歩に応じて適時にアップデート・見直しが必要となります。

この評価フレームを理解し活用することで、生成AIを機械システム設計・開発の現場で適切に利用するための基本的な考え方やチェックポイントを把握することが可能となります。これにより、機械システム設計・開発における生成AIの使用に関する効果・影響とリスクの評価の具体的なイメージと、配慮が必要な点を分かりやすく整理することができます。

[生成AIの使用に関する効果・影響とリスクの評価フレーム]

生成AIを活用する際には、その使用に関する効果・影響とリスクを評価することが重要です。この評価フレームは、生成AIの活用がもたらす可能な結果を明確に理解し、それに対する対策を立てるための基本的な枠組みを提供します。

[活用におけるメリットとデメリットのマッピングの方法]

生成AIの活用には多くのメリットがありますが、同時にデメリットも存在します。そのため、生成AIを活用する際には、そのメリットとデメリットを明確にマッピングし、それぞれを理解することが重要です。

その際、現時点では、生成AIの活用におけるメリットの方が、まだ出揃ってない状況であり、今後、意外な活用法やキラーアプリとも言えるような活用法が出てくることが期待できます。

その一方で、新たな活用法では、これまでに顕在化していないリスクが潜んでいる可能性がある点にも留意が必要です。

したがって、現時点で完全に網羅できるものではないという制約を踏まえた上で、このようなフレームワークによる系統的な評価を積み重ねていくことが有効であると考えられます。

[技術レベルの進展と評価フレームのアップデート]

生成AIの技術レベルは日々進展しています。生成AIの活用は、今後もさらに進展し、その活用範囲は広がると予想されます。そのため、生成AIの使用に関する効果・影響とリスクの評価方法も、その進展に合わせて進化していく必要があります。また、本章で説明する評価フレームの考え方もその進展に合わせて適時にアップデート・見直しを行い、今後、新たなリスクモードに対する解像度を上げていく取り組みが必要となります。これにより、生成AIの最新の技術レベルに対応した評価が可能となると考えられます。

6-2. 機械システム設計・開発における生成AI の評価方針

国際規格ISO 9241-11:2018,Ergonomics of human-system interaction−Part 11: Usability: Definitions and conceptsを修正(MOD)した、日本産業規格「JIS Z 8521:2020 人間工学-人とシステムとのインタラクション-ユーザビリティの定義及び概念」では、ユーザビリティ(usability)を、「特定のユーザが特定の利用状況において、システム、製品又はサービスを利用する際に、効果、効率及び満足を伴って特定の目標を達成する度合い。」と定義しています。

当該規格では、効果(effectiveness)は、「ユーザが特定の目標を達成する際の正確性及び完全性。」と定義されています。組織における業務の主な効果は、当面の業務に対して得られる短期的効果ですが、それに従事した人材の成長、育成という長期的効果も含まれると考えることができます。これは、機械システム設計・開発に生成AIを用いることにより、当面の業務に対して得られる短期的効果だけでなく、従事した人材の育成という長期的効果も評価するべきことを示唆しています。ただし本フォーラムは、1年未満の短期的活動であることから、後者については評価の必要性の言及にとどめることとします。

効率(efficiency)は、「達成された結果に関連して費やした資源(典型的な資源は、時間、人間の労力、コスト及び材料を含む)」と定義されています。生成AIを用いることにより、要する労力や時間などが従来よりどの程度削減されるかの評価となります。

満足(satisfaction)は、「システム、製品又はサービスの利用に起因するユーザのニーズ及び期待が満たされている程度に関するユーザの身体的、認知的及び感情的な受け止め方」と定義されています。これは、生成AIを用いたいという気持ち、達成感、やりがいなどが向上するか低下するかの心理的影響も評価するべきであることを示しています。しかし本フォーラムは、1年未満の短期的活動であることから、これについては評価の必要性の言及にとどめることとします。

利用状況(context of use)は、「ユーザ、目標及びタスク、資源並びに環境の組合せ(利用状況の環境は、技術的、物理的、社会的、文化的及び組織的環境を含む)」と定義されています。これは、生成AIの評価において、それが用いられる業務、目的、組織なども考慮するべきであることを示しています。

以上を参考に、本報告書では、機械システム設計・開発における生成AI の評価において、その利用状況を考慮した上で、効果、効率、満足の観点を含めるものとします。なお、以降記述の簡潔性のため、ユーザビリティにおける効果向上と効率向上をまとめて、一般的な語として「効果」と記す場合があります。

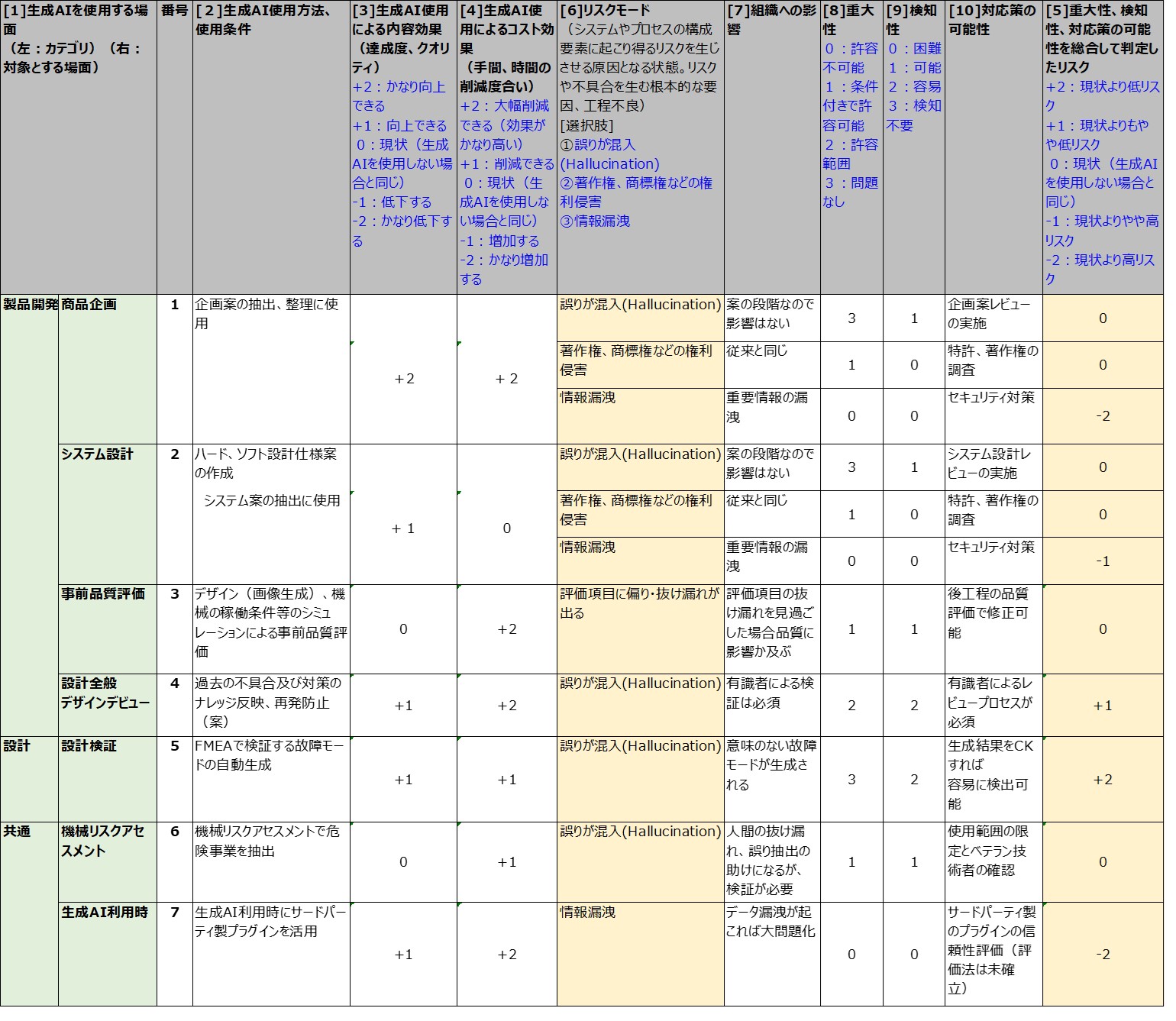

6-3. 生成AIの使用に関する効果・影響とリスクの評価フレーム

【1】序論

第1章に記載のとおり本フォーラムの目的は、機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける生成AI の使用に関する効果・影響とリスクの考え方、系統的な評価のあり方の検討を行うことです。

本章では、生成AIを機械システムの設計開発における各タスクに適用した場合の効果とリスクモードを解析する「生成AIタスク効果・リスクモード解析(Generative AI Task Effect and Risk Mode Analysis)」に関して、本フォーラムで考案した考え方について説明します。

なお、本評価手法は、生成AIの現時点での技術レベルを前提として提示するものであり、今後の生成AI及びその活用に関する技術レベルの発展に応じて、適時のアップデート・見直しされることが期待されます。一方で、機械システムの設計開発の現場で生成AIを活用する上での基本的な考え方、チェックポイントは、一般性を有するものであると考えられます。

【2】機械システム設計・開発における生成AIの使用に関する効果・影響とリスクを考える上での留意事項

(1) 技術の進歩とリスク評価

生成AIの様に文字通り日進週歩で進歩するシステムは、現状使用できるシステムバージョンの評価に限定すると、生成AIの効果・影響とリスクの本質を把握できない可能性があります。現在の生成AIのバージョンでは、可能なことが限定的で、その課題も認識できていますが、システムが進化したり使用者が拡大したりしていくと、AIに関する関心・認識が薄くなり、活用機会の逸失や予期せぬトラブル発生の可能性も懸念されます。

本章における記載内容は、一般的な整理を前提にした内容ではなく、本フォーラムへの参加者間で議論した評価であることに注意を要します。したがって、以下の内容が自身の組織等で活用できるかについては、読者ご自身で判断いただく必要があります。生成AIは現在進行形で進展していますが、最新を追いかけ続けると具体的評価が難しいため、本章では、具体的評価を試行するため、ある時点でのバージョン(Chat GPT-3.5)を決めて検討を進めたものです。

(2) 本章での効果・影響とリスクの評価の対象範囲

現在、AIの活用のあり方が世界的に議論されています。AI自体は応用範囲の広い技術ですが、多岐に渡る分野やプロセスにおける採用の可能性を判断するのは、限られた期間では難しかったり、一般的過ぎて具体性を欠く結果に終わる可能性も考えられます。

本フォーラムでは、「第1章 フォーラムの趣旨」に記載のとおり、機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける生成AI の活用可能性、効果の検討と課題抽出、使用に関する効果・影響とリスクの考え方、系統的な評価のあり方に検討範囲を限定した内容となっている点に注意を要します。

(3) 使用方法によるリスク

リスクに関しては、どのような生成AIをどのような組織・人材でどのように使用するかによって大きく変化するため、その評価に際しては、使用する組織、使用場面、使用方法等を特定することが必要となります。また、リスクの影響の不確かさ自体も判断を行う上での重要なリスク要因であり、必ずしも一意的にリスク値を定めることが即ち適切なリスク評価となる訳ではない点に留意する必要があります。

(4) メリット・デメリットの二面性

科学技術、システム技術は、その好ましい影響のために活用するものであり、好ましくない影響のみをリスクとして評価するだけでは、その活用判断要素として十分ではありません。こうした観点から、本章では、R-Map(2軸とも損害の程度と頻度)に示されるような整理でなく、効果とリスクの2軸からの評価によりまとめることとしました。

(5) 設計開発人材育成への影響

生成AIと人間との役割分担に関して、生成AIにある作業を任せ、その作業の本質を経験しない技術者が高度な判断や創造的な業務だけこなせるのかという基本的な疑問も生じます。こうした課題については、その導入のステップや、導入後の技術者教育自体もリスク対応策と併せて議論すべきものです。さらに、生成AIを導入した際の設計開発者のモチベーションの維持や業務転換といった課題も生じます。

本章で説明する評価フレームでは、人材育成への影響については、生成AIの活用用途による内容より、活用用途によらない共通の内容が多いと考えられるため、リスクモードの検討の際に用途ごとの各々のリスク評価の整理には含めず、全体として議論し整理することとしました。

上記(1)~(5)に記載した留意すべき点も踏まえ、機械システムの設計、開発、運用等のプロセスにおける生成AI の使用に関する効果・影響とリスクの評価フレームについては、継続的に改善していく仕組みを構築しておくことが必要です。

【3】基本的な考え方

生成AIタスク効果・リスクモード解析では、[1] 機械システム設計開発において生成AIを使用するタスクごとに、[2] 生成AIの使用方法、使用条件 をできる限り明確に分けて狭い範囲で評価することを基本とします。

その際の評価軸は、[3] 生成AIの使用による効果向上(達成度、クオリティ)および[4] 生成AI使用による効率向上(手間、時間の削減度合い)に対する[5] 重大性、検知性、対応策の可能性を総合して判断したリスクの2軸での評価を行うものです。

評価の際の[6] リスクモード(システムやプロセスの構成要素に起こり得るリスクを生じさせる原因となる状態。リスクや不具合を生む根本的な要因、工程不良)は、FMEAにおけるfailure modeの考え方を参考に設定したもので、各使用場面に対して共通するリスクと考えられる以下の3項目によって整理を行います。

① 誤りが混入(ハルシネーション)

② 著作権、商標権などの権利侵害

③ 情報漏洩

【4】評価基準

上記の「[3] 生成AIの使用による効果向上」、「[4] 生成AI使用による効率向上」、および「[5] 重大性、検知性、対応策の可能性を総合して判断したリスク」の評価基準は、現状(生成AIを使用しない場合と同じ)を基準(評点0)とする相対評価(評点-2~+2)によって行います。

その際、「効果、効率」は可能な限り「リスク」と独立に判断します。例えば、幻覚により内容が良くない場合や、対策の手間を要し効率が下がる場合もあり得ますが、それらがなかった場合に最高でどこまでの効果向上、効率向上が期待できるかで評価します。また、「リスク」は可能な限り「効果、効率」と独立に判断します。例えば、幻覚などにより起こり得る最悪の場合を評価します。(※[3][4]と[5]は、独立して判断する。)

機械システムの設計、開発、運用等のプロセスにおける生成AIタスク効果・リスクモード解析の例を 【表1】 に示します。

【表1】 機械システムの設計、開発、運用等のプロセスにおける生成AIタスク効果・リスクモード解析の例

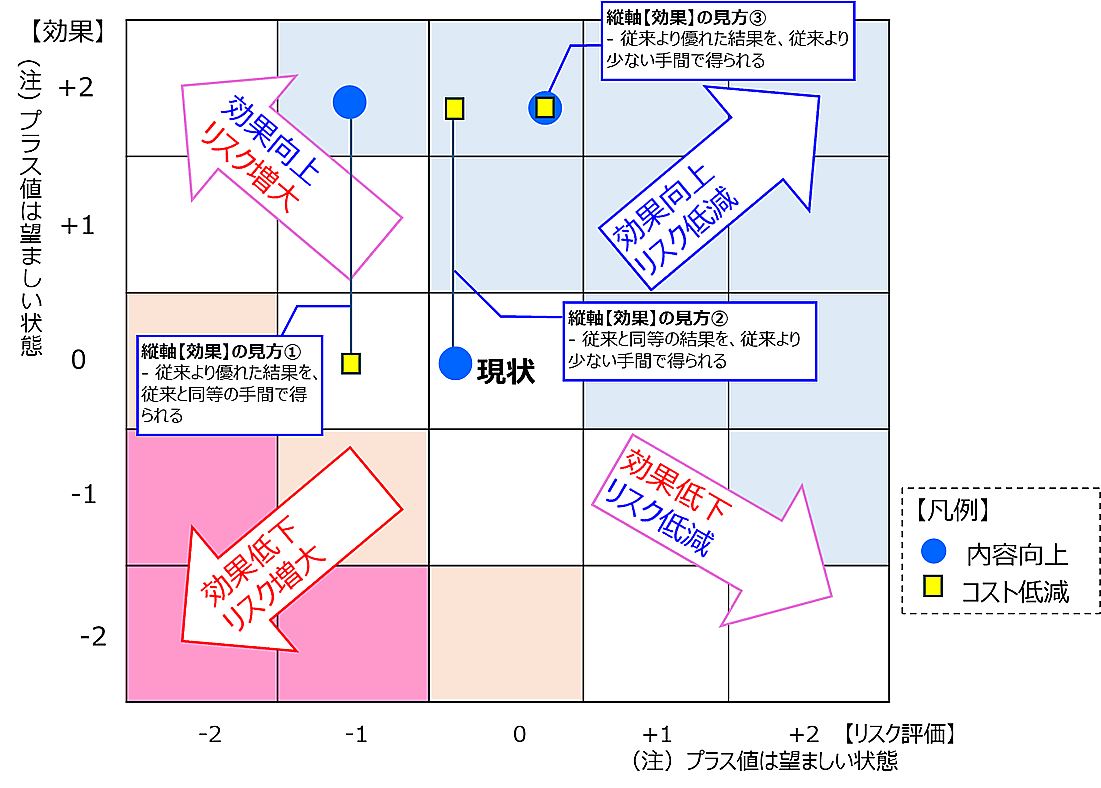

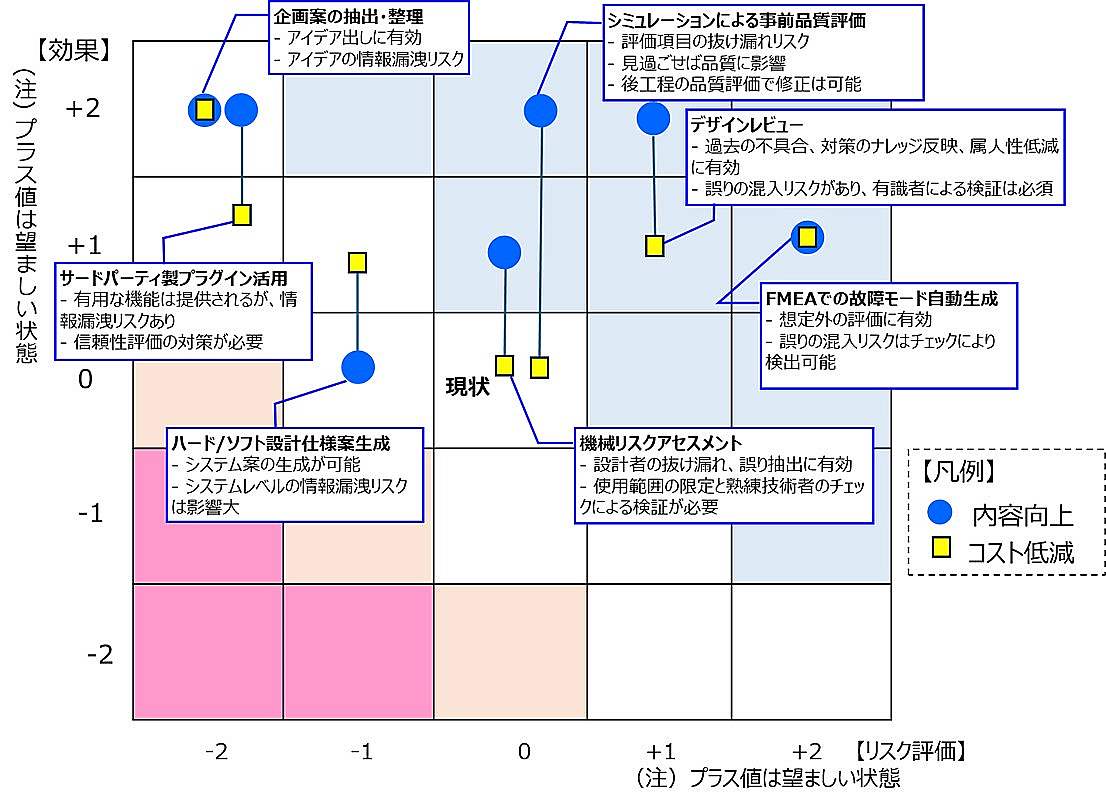

6-4. 活用におけるメリットとデメリットのマッピングの方法論について

【1】マッピングの方法論

上記6-3.の評価フレームによる評価結果を分かりやすく可視化するためのマッピングの方法に関して、本フォーラムで考案した考え方について説明します。ここでは、このマップを「生成AI効果・リスクマトリックス(Generative AI Effect and Risk Matrix)」と呼ぶこととします。

生成AI効果・リスクマトリックスでは、縦軸を効果、横軸をリスクとする2軸のマップとしてプロットします。これにより、効果の向上・低下に対するリスクの増・減の度合いを一定の評価基準に従って目に見える形で整理することができます。

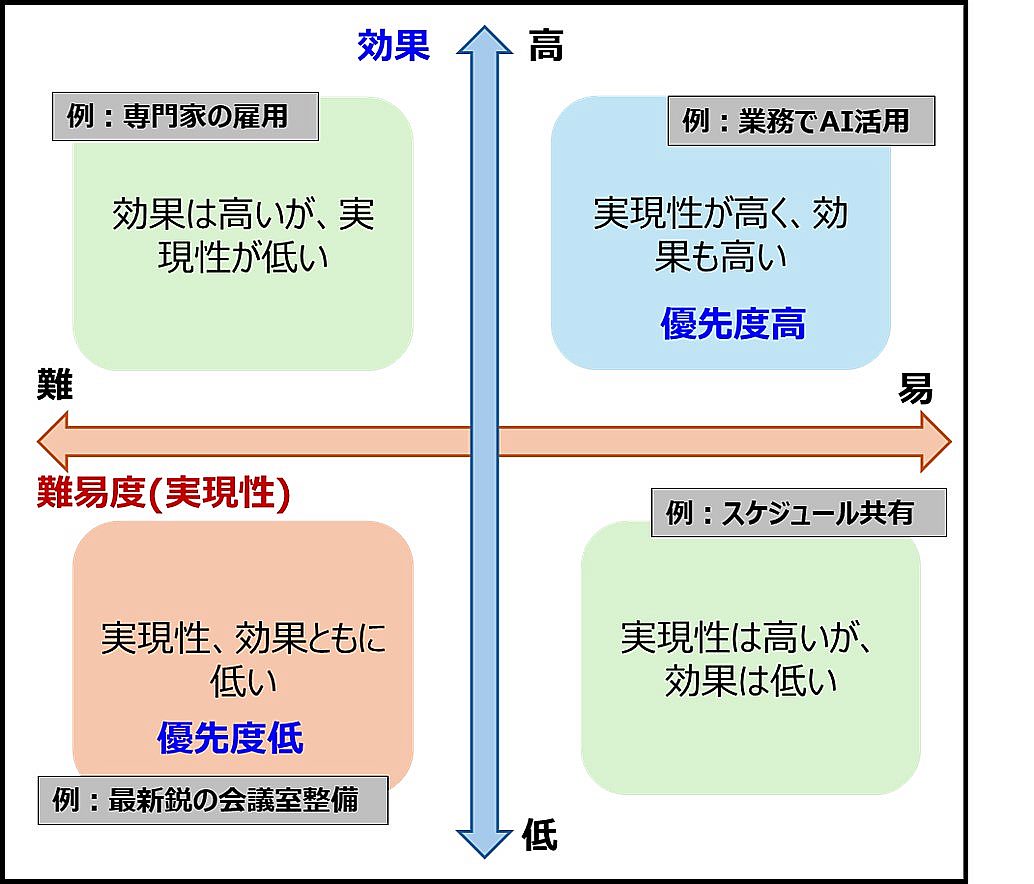

本手法と類似した2軸によるマッピングの考え方としては、Payoff Matrix ([堀2013]、実効性と実現性によるマッピング)などが挙げられます((参考2) を参照)。

【2】マッピングの作成方法と解釈

【図9】 は、生成AI効果・リスクマトリックスのマッピングの手法と意味合いを図示したものです。

● は、機械システム設計開発に生成AIを活用することによる効果向上の度合いをプロットしたものです。また、□ は、生成AIを活用することによる効率向上の度合いをプロットしたものです。

縦軸、横軸のいずれも、プラス値は望ましい状態、マイナス値は望ましくない状態を示します。

ここで縦軸の効果の見方に関しては、図中に例示した「縦軸【効果】の見方①」では、従来より優れた結果を、従来と同等の手間で得られることを示しています。「縦軸【効果】の見方②」では、従来と同等の結果を、従来より少ない手間で得られることを示しています。「縦軸【効果】の見方③」では、従来より優れた結果を、従来より少ない手間で得られることを示しています。

このような考え方で、【表1】 において整理した生成AIタスク効果・リスクモード解析の例をプロットすると、【図10】 に示すマッピングとなります。図の右上部の水色ゾーンにプロットされる活用事例では、効果の向上とリスクの低減の両方が期待されるものと考えられます。

【図9】 生成AI効果・リスクマトリックスの解説

【図10】 生成AI効果・リスクマトリックスのマッピング事例(例示)

機械システムの設計、開発、運用等のプロセスにおける生成AI の使用に関する効果・影響とリスクについての評価フレームによる評価結果を、このようにマッピングすることで、生成AIを機械システム設計・開発の現場で適切に生成AIを利用する際の効果やリスク、チェックポイントを分かりやすく整理し、示すことが可能となります。

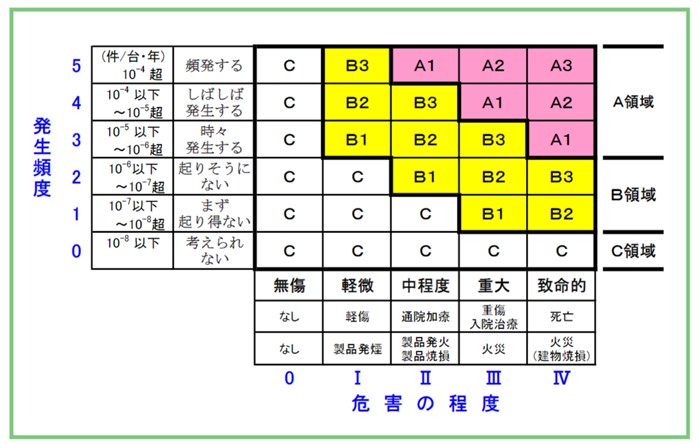

(参考1)安全評価におけるR-Mapの考え方

(説明)安全評価におけるリスクマップとして知られるR-Map 手法では、下図のように数値基準の入ったマトリックスを使用してリスクの大きさを評価します。ここでは、縦軸、横軸の両軸ともにネガティブな影響度をとっている点が特徴となっており、縦軸を「発生頻度」、横軸を「危害の程度」として、6×5 の 30 個のセルにリスクが分けられています。

(出典)リスクアセスメント・ハンドブック[実務編](2011年6月 経済産業省)P.10より引用

(参考2)Payoff Matrix [堀2013]

(説明)Payoff Matrixは、様々な意見やアイデアについて、問題解決の効果と難易度の双方を勘案し、パフォーマンスが高い意見やアイデアを絞り込む際に有用な手法です。横軸に難易度(コスト、時間など)、縦軸に効果をとる2軸の評価により、効果が高くかつ簡単に実行できる意見やアイデアを抽出するのに役立ちます。

第7章 まとめ

7-1. はじめに

「生成AI の機械システム設計開発への活用フォーラム」では、機械システム、生成AI、ユーザ企業の有識者から構成する委員会(フォーラム)を設置し、主に以下の観点から生成AI の機械システムの設計、開発、運用における活用可能性を議論しました。

本章では、前章までで解説した内容に関して、改めてこれまでの活動で得られた成果のサマリーを簡潔に記載します。

「第1章 フォーラムの趣旨」に記載のとおり、以下の2点について、5回にわたり専門家からの講演、参加いただいた委員による試行結果のフィードバックを交えて、討議を進めてきました。

【1】 ChatGPT 等の生成AI について機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける使用結果に基づく活用可能性、効果の検討と課題抽出。

【2】 機械システムの設計、開発、現場での運用のそれぞれのプロセスにおける生成AI の使用に関するリスクマネジメントの考え方、R-map 等による系統的なリスク評価のあり方の検討。

7-2. 機械システムの設計、開発における活用可能性について

上記【1】の生成AIの活用可能については、本フォーラムの委員による試行結果のフィードバックでは、評価結果にはばらつきが見られましたが、生成AIの使い方次第では大きな効果がある一方、情報漏洩などのリスクについての指摘もありました。

主な活用分野としては、製品の企画・設計段階における構想の壁打ち相手としての利用、設計検証や品質改善への活用など、機械システムの設計開発の全般にわたり今後の更なる活用が期待できます。

一方で、人間が正誤判断を下せないAIの生成をプロセスで利用することの難しさ、該当プロセスの専門知識が乏しい作業者でも生成AIを用いて業務を行えるか不明確であることなど、設計開発の業務に活用する上での課題についても、フォーラムの場で議論されました。

また、各社が最大限生成AIを活用すると類似性のある回答を利用することになる可能性があり、単に効率化の追求だけでは画一化に陥ってしまうのではないかとの指摘もありました。

そうした課題も理解した上で、ドラフト作成や検証結果のまとめの整理などは生成AIが最も早期に価値を発揮しやすい活用例のひとつになるものと考えられます。したがって、設計開発の現場でのさまざまなドラフト作成などから、まずは活用を始めるというのが、比較的容易な活用法であると考えられます。その上で、徐々に本格的な活用に進んでいくことが期待されます。

また、ユーザ視点からは、機械システムの設計開発における生成AIの評価において、ユーザビリティの効果、効率、満足、利用状況の観点を取り入れることが、有効です。併せて、現在、グローバルに議論が進んでいるように、生成AIの安全性、セキュリティ、個人情報、著作権等の項目も含めて活用を検討していくことが重要です。

このように、機械システムにおける設計開発分野では、企業の競争力の維持・強化のためには生成AIの適切な使用方法、活用上の課題などに関する検討を進めることが急務です。

7-3. 機械システム設計・開発における生成AIの使用に関する効果・影響とリスクの評価について

本フォーラムでは、機械システム設計・開発における生成AIの使用に関する効果・影響とリスクに関し、縦軸を効果、横軸をリスクとする2軸のマップとしてプロットする方法論を検討し、基本的な考え方を示しました。

こうした考え方により、生成AIの活用による効果に対するリスクの増減の度合いを一定の評価基準に従って目に見える形で整理することができ、企業の設計開発現場での生成AI活用の判断指針として活用できるものと考えられます。

現時点では、機械システムの設計開発における生成AIの活用により得られるメリットが十分出揃ってない状況にあるため、意外な活用法やキラーアプリとも言えるような活用法がこれから出てくるものと考えられます。こうした現状の理解の下に、現時点で完全に網羅できるものではないという制約を踏まえた上で、本報告書において示したようなフレームワークで評価の実績を系統的に蓄積していくことは、有効なアプローチであると考えられます。

また同時に、機械システムの設計開発分野における生成AIの活用において、進むべき活用の方向性が共有されていくことにつながり、イノベーションが促進されることが期待されます。

なお、今回示した生成AIの使用に関する効果・影響とリスクの評価方法の考え方については、今後、機械システム設計・開発における生成AIの活用を進める中で、更にアップデートを重ねていくことが重要です。

(以上)

©2024 一般財団法人 機械システム振興協会

転載や複製等により使用する場合は、ご連絡ください。

〒105-0012

東京都港区芝大門1丁目9番9号 野村不動産芝大門ビル9階

<contact>はこちらからお願いします。