近年の AI(Artificial Intelligence、人工知能)技術への関心の高まりと相まって、その利用による社会的リスクについても関心が高まり、そのガバナンスの必要性が指摘されています。

計 10 回にわたる本コラムでは、このような AI 技術による社会的リスクとそのガバナンスを巡る全体像について俯瞰していきます。

本連載の筆者は、市川類 東京科学大学 データサイエンス・AI全学教育機構 特任教授 / 一橋大学 イノベーション研究センター 特任教授 です。

©2024 Tagui Ichikawa(本コンテンツの著作権は、市川 類 様に帰属します)

第9回 AI に係る将来的な不安感と世界における AI ガバナンス政策の動向

これまでのコラムにおいては、AI 技術の利用によって生じる社会的リスクについて、概観的に説明してきました。

今回のコラムにおいては、このような社会的リスクに加えて、AI に対する将来的な不安感という観点も含めて、世界での AI ガバナンス政策の動きについて、ご説明します。

(1) AI に対する将来的不安感

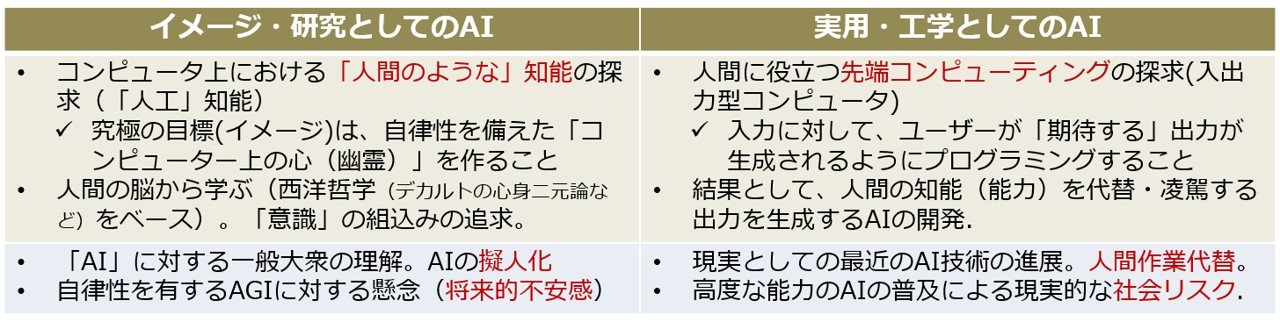

これまで、本コラムでは、AI(人工知能)技術を「実用・工学としての AI」としてとらえて、その具体的な社会的リスクの可能性について説明してきました。しかしながら、AI技術には、もう一つの側面、すなわち、「イメージ・研究としての AI」という認識が社会的に共有されている点において、他の工学技術とは異なる特徴を有し、これが世界の AI ガバナンス政策の形成に大きな影響を与えています(図25参照)。

もともと、「人工知能(AI)」とは、1950 年代に、人間の知能をコンピュータ上に実現することを目的とした研究を対象に命名されました。しかしながら、その後、近年の AI 技術として目覚ましい発展が進んできたのは、「工学・実用システム」としての AI であり、この AI 技術は様々な社会的なリスクを引き起こす可能性があるのは、これまでの説明してきた通りです。一方、AI 技術は、その名称・イメージがゆえに、このまま発展が続くと、将来的には、コンピュータ上に人類の知性を超えるようなもの、すなわち汎用 AI(AGI: Artificial General Intelligence)が登場するのではないか、その結果、人類を破滅させる結果になるのではないかという将来的な不安感を引き起こすことになります。

この結果、これまで説明してきた社会的リスクの具体的な顕在化だけではなく、むしろこのような将来的な不安感が大きな牽引力となって、世界的な AI ガバナンス政策の議論が進んできました。

図25:二つの AI の概念

(2) 世界的な AI ガバナンス政策に係るこれまでの経緯

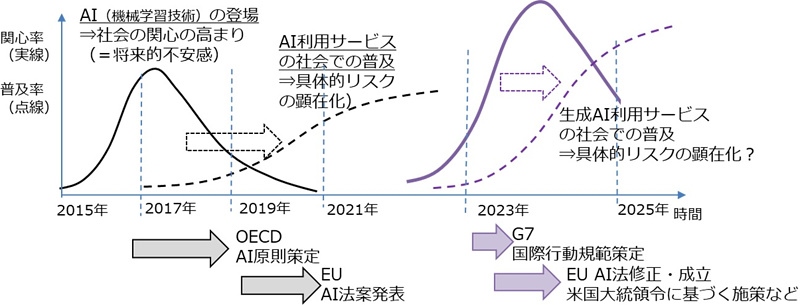

実際に、これまでの世界の AI ガバナンス政策の経緯をみると、このような AI に対する将来的な不安感が大きな影響を与えてきており、特に、今回の生成 AI ブーム以降は、その強力な能力がゆえに、特に欧米を中心に将来的な不安感を再度引き起こし、AI ガバナンス政策の在り方は世界的な関心事項となっています。

具体的には、第三次 AI ブームにおいて、一時期、AGI に対する将来的な不安感が生じ、それがきっかけとして「AI 倫理」が話題になり、AI ガバナンスの一環として、最終的には 2019 年に OECD の AI 原則が策定されました。その後、AGI に対する不安感は徐々に薄れていったものの、AI システムの社会的な普及に伴い、具体的な社会的リスクが一部顕在化してきました。その結果、欧州の AI 法案など、AI に係る規制制度が具体的に議論されるようになりました。 その後、2023 年になって、今回の生成 AI ブームにより、AGI に対する将来的な不安感が再度欧米を中心に世界的に急拡大し、生成 AI の急速な社会普及による社会的リスクの顕在化と相まって、世界的に AI 規制に向けて動きが進んでいます。具体的には、欧州の AI 法案の修正・追加・成立、米国における AI 安全に係る大統領令の発表などに加え、G7/OECD、国連などの国際機関などでも活発に議論が進んできています(図26参照)。

図26:AI の関心の高まり/普及とガバナンスの経緯

(3) AI の将来的不安感に係る地域的差異と欧州 AI 法

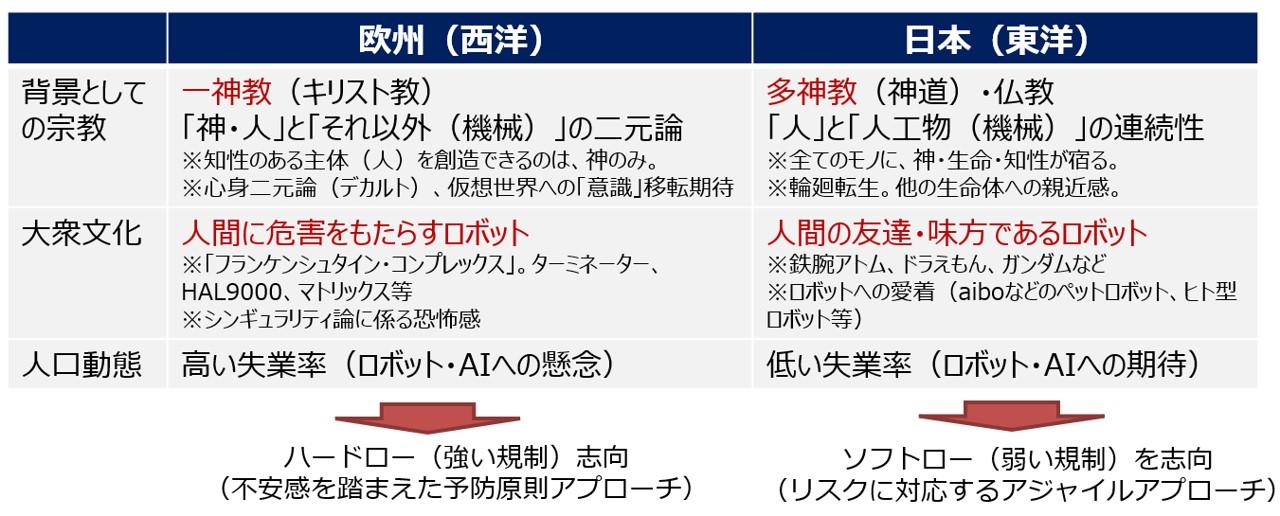

このような欧米における AI に対するハードローによる強い規制志向の動きと比較して、日本では、自主的なガイドラインの発行などソフトローによる比較的弱い規制を志向しており、世界全体では、AI ガバナンス政策に係る多様性が指摘されています。

これは、そもそも、AI(AGI)に対する将来的不安感は、人間と機械(AI)関係に係る文化的な認識に依存するものであり、そのような中、日本ではその不安感が相対的に低いことが理由に挙げられます(図27参照)。特に、欧米では一神教(キリスト教)を背景に、知性ある主体を創造できるのは神だけであり、人間が知性ある主体を創造することは神への冒涜であり、人類の破滅を引き起こしかねないとの思想的背景が存在します。また、このような宗教的文化を背景に、大衆文化においても、AI・ロボットが人類に危害を及ぼす存在として描かれていることが多いとされます。これに対して、日本では、一般的に多神教(神道など)を背景に、あらゆるモノに知性(神様)が宿りうるとの思想を有しており、また、このような宗教的文化を背景に、日本では、鉄腕アトム、ドラえもんなど、AI・ロボットは、人間の友達・味方として描かれることが多いとされます。

このような文化的な差異を背景に、欧州では、AI による社会的リスクに係る未然防止の観点も含めて、日本と比較して厳しい規制制度を志向しつつあります。特に、2021 年に提案された欧州 AI 法案は、この 2024 年 5 月に成立し、今後、随時施行されることになります。その際、欧州に事務所がない企業であっても、欧州の消費者に対してサービスを提供する場合には、本 AI 法の遵守が求められ、違反すると多額の罰金が科される可能性があります。このため、例えば、ネットなどを通じて AI を利用したサービスを行う場合には、日本での常識のみに従って対応するのではなく、世界の AI ガバナンス政策動向も視野を入れて対応に取り組む必要があります。

図27:社会規範の差異によるガバナンスの特徴

これまでのコラム

(第1回)イノベーションのためのガバナンス

(第2回)社会規範・倫理と技術による社会的リスク

(第3回)社会的リスクに対応する制度としてのガバナンス

(第4回)AI 技術の利用がもたらす社会的リスク

(第5回)信頼性・安全性に係る社会的リスク

(第6回)プライバシーに係る社会的リスク

(第7回)公平性・妥当性に係る社会的リスク

(第8回)コンテンツ規範に係る社会的リスク

筆者紹介 市川 類(いちかわ たぐい)

東京科学大学 データサイエンス・AI全学教育機構 特任教授

一橋大学 イノベーション研究センター 特任教授

筆者紹介の詳細は、第1回をご参照ください。